当社のSmarteCAMは、強力な処理機能を備えた、すぐに導入可能な人工知能を搭載したカメラです。オンボードのNvidia Jetson TX2CPUと256コアGPUが付属しており、すべての画像処理と分析を独自に実行します。この記事では、SmarteCAMでNvidia DeepStreamパイプラインを実行し、このデバイスを展開できるアプリケーションとそのパフォーマンスを紹介します。

DeepStreamとは?

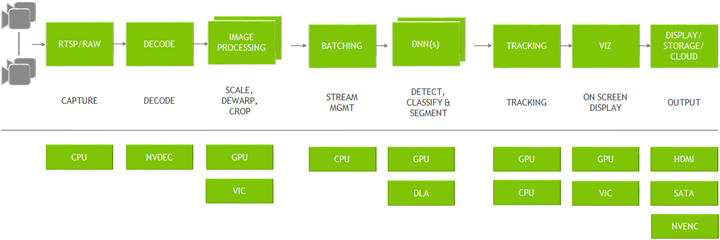

Nvidia DeepStreamソフトウェア開発キット(SDK)は、Intelligent Video Analytics(IVA)パイプラインを構築するための高速AIフレームワークです。Nvidia T4、Nvidia Ampere、およびNVIDIA Jetson Nano、Nvidia Jetson AGX Xavier、Nvidia Jetson XavierNX、Nvidia Jetson TX1/TX2などのプラットフォームで動作します。

基本的に、DeepStreamは人気のあるGStreamerフレームワークのためのプラグインのバンドルです。これらのプラグインは、ディープラーニングビデオ分析パイプラインに通常必要とされるタスクを実行します。また、これらはGPUで実行するように高度に最適化されています。その結果、画像がGPU内の処理から漏れることがほとんどないため、非常に効率的で迅速なビデオ分析パイプラインが得られます。

これらのプラグインの最も興味深い側面の1つは、TensorRTエンジンの実行可能にするGst-nvinferプラグインです。このほか、マルチオブジェクトの追跡を行うGst-nvtrackerプラグインや、マルチストリームバッチ処理を効率的に行うGst-nvstreammuxプラグインなど、いくつかのプラグインが用意されています。

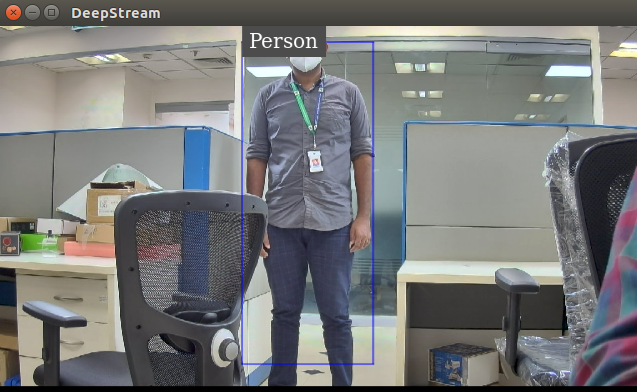

NVIDIA DeepStreamパイプラインは、当社のSmarteCAMにすでにインストールされています。一度導入すれば、すぐに利用できます。

DeepStreamのフォルダはここにあります。/Opt/Nvidia/DeepStream/DeepStream-4.0 をご参照ください。

次に、サンプルのオブジェクト検出モデルを実行してみましょう。

SmarteCAMによる優れたオブジェクト検出

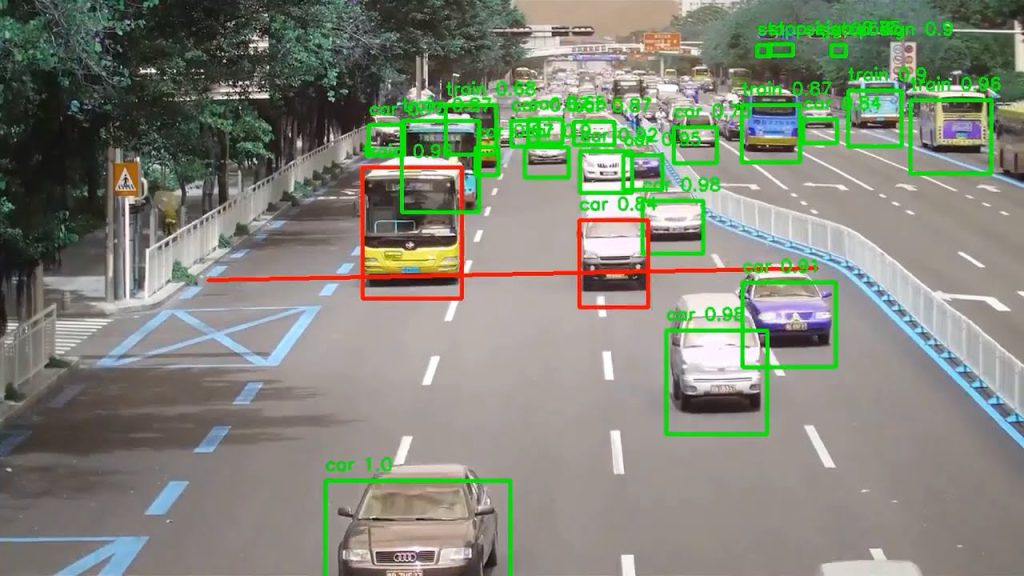

私たちは画像や映像を見るとき、数秒のうちに興味のある物体の位置を簡単に特定し、識別することができます。物体検出は、この知能をコンピューターに渡し、物体の位置確認や 識別をサポートするものです。物体検出は、ビデオ監視、画像検索システム、自動運転車など、さまざまな分野で活用されています。物体検出には様々なアルゴリズムがありますが、ここではYoloV3アルゴリズムに焦点を当てます。

SmarteCAM-IP66定格のカメラはHDR機能を搭載しているため、交通違反の検出や識別から、車両認識、ナンバープレート認識、群集監視など、屋外での使用に最適です。

サンプルアプリケーションの実行

サンプルアプリケーションを実行するには、ターミナルを開いてコマンドを実行します

$ DeepStream-app -c /opt/Nvidia/DeepStream/DeepStream-4.0/samples/configs/DeepStream-app/source4_1080p_dec_infer-resnet_tracker_sgie_tiled_display_int8.txt

HDRカメラでサンプルアプリケーションを実行するには、構成ファイルを変更する必要があります。

/opt/Nvidia/DeepStream/DeepStream-4.0/samples/configs/DeepStream-app/source4_1080p_dec_infer-resnet_tracker_sgie_tiled_display_int8.txtフォルダーに移動し、[source0]と[tracker]フィールドの変更を行ってください。

[source0]

enable=1

#Type – 1=CameraV4L2 2=URI 3=MultiURI 4=RTSP

type=1

camera-width=640

camera-height=480

camera-fps-n=60

camera-fps-d=1

camera-v4l2-dev-node=0

#uri=file://../../streams/sample_1080p_h264.mp4

num-sources=1

#drop-frame-interval=2

gpu-id=0

#(0): memtype_device – メモリタイプデバイス

#(1): memtype_pinned – 固定されたメモリタイプホスト

#(2): memtype_unified – メモリータイプユニファイド

cudadec-memtype=0

…….

…….

…….

- 端末を開く

- DeepStreamアプリを使用して構成ファイルを実行します

$ DeepStream-app -c /opt/Nvidia/DeepStream/DeepStream-4.0/samples/configs/DeepStream-app/source4_1080p_dec_infer-resnet_tracker_sgie_tiled_display_int8.txt

SmarteCAMについてもっと知りたい場合は、SmarteCAM にアクセスするか camerasolutions@e-consystems.com までお問い合わせください。

次のブログでは、SmarteCAMをさらに深く掘り下げ、SmarteCAMがオブジェクト検出の最新かつ最速のバージョンである理由をよりよくご紹介いたします。 今後ともよろしくお願いいたします。