機械学習、人工知能、組み込みビジョン、および処理技術の進歩により、イノベーターは人間の監視をほとんど必要とせずに環境をナビゲートできる自律型マシンを構築できるようになりました。このようなデバイスの例には、AMR(自律移動ロボット)、自律トラクター、自動フォークリフトなどがあります。

そして、これらのデバイスを完全に自動化するには、手動ナビゲーションなしで移動できる性能が必要です。そのためには、マッピング、位置確認、経路計画、および障害物の検出と回避の目的で深度を測定する機能が必要です。ここで、深度センシングカメラが活躍します。

この記事では、深度センシングカメラとは何か、その種類、動作原理を学び、最後にこれらの新時代のカメラを使用した最も人気のある組み込みビジョンアプリケーションについて簡単に紹介します。

深度センシングカメラとその種類とは?

深度センシングとは、デバイスからオブジェクトまでの距離、または2つのオブジェクト間の距離を測定することを意味します。この目的のために深度センシングカメラが使用され、近くにある物体の存在を自動的に検出し、その物体までの距離を移動中に測定することができます。これにより、深度センシングカメラと統合されたデバイスまたは機器が、リアルタイムで知的な決定を下して自律的に移動できるようになります。

現在利用可能なすべての深度テクノロジーのうち、最も人気があり、一般的に使用されている3つのテクノロジーは次のとおりです。

- ステレオビジョン

- Time of flight

- ストラクチャードライト

次に、それぞれの動作原理を詳しく見てみましょう。

ステレオビジョン

ステレオカメラは、人間の目と同じ原理、つまり両眼視をベースにしています。人間の両眼視は、ステレオ視差と呼ばれるものを使用してオブジェクトの深度を測定します。ステレオ視差とは、2つの異なるセンサーやカメラ(人間の場合は目)から見たオブジェクトの位置の違いを用いて、オブジェクトまでの距離を測定する技術です。

以下の画像は、この概念を非常によく示しています。

図1 – ステレオ視差

図1 – ステレオ視差

ステレオカメラの場合、深度は通常ホストプラットフォームで実行されるアルゴリズムを使用して計算されます。しかし、カメラが効果的に機能するには、2つの画像に十分な詳細度と質感が必要です。このため、広い視野を必要とする屋外アプリケーションにはステレオカメラが推奨されます。

ステレオ カメラの動作原理の詳細については、ステレオ ビジョンカメラとは? の記事を参照してください。

Time of Flightカメラ

Time of Flight (ToF) は、光が特定の距離を移動するのにかかる時間を指します。Time of Flightカメラはこの原理に基づいて動作し、放射された光が物体の表面で反射してからセンサーに戻るまでの時間を使用して、物体までの距離を推定します。

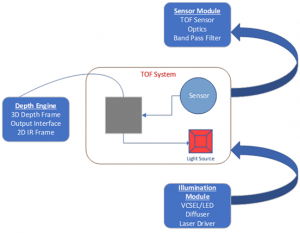

Time of Flightカメラには、次の3つの主要コンポーネントがあります。

- ToFセンサーとセンサーモジュール

- 光源

- 深度センサー

Time of Flighカメラのアーキテクチャは次のとおりです。

図 2 – Time of Flightカメラのアーキテクチャ

図 2 – Time of Flightカメラのアーキテクチャ

センサーとセンサーモジュールは、対象物から反射された光データを収集します。センサーは、収集した光を生のピクセルデータに変換します。 使用される光源は、通常NIR (近赤外線) 領域で光を発する VCSELまたはLEDです。深度プロセッサの機能は、センサーからの生のピクセルデータを深度情報に変換することです。さらに、ノイズフィルタリングにも役立ち、最終アプリケーションの他の目的に使用できる2D IR画像を提供します。

Time-of-Flight カメラの仕組みについて詳しく知りたい場合は、「ToF センサーとは?」「ToF カメラの主要コンポーネントは?」をご参照ください。また、Time-of-Flight (ToF) を他の 3D 深度マッピング テクノロジーと比較する方法をご覧ください。

ストラクチャードライトカメラ

ストラクチャードライトベースの深度センシングカメラは、レーザー/LED 光源を使用して、光パターン (主に縞模様) をターゲットオブジェクトに投影します。得られた歪みに基づいて、オブジェクトまでの距離を計算できます。ストラクチャードライト3Dスキャナーは、オブジェクトの3Dモデルを再構築するためによく使用されます。

3つの深度センシング技術の比較

上で説明した3つの3D深度マッピングカメラにはすべて、それぞれ長所と短所があります。使用するカメラの選択は、最終アプリケーションの仕様に完全に依存します。カメラの評価と統合プロセスについては、当社のようなイメージングのエキスパートのアドバイスを受けることを強くお勧めします。

3つの技術は、10の異なるパラメーターを使用して分析できます。 詳細な比較を以下の表に示します。

| ステレオビジョン | ストラクチャードライト | TIME-OF-FLIGHT | |

| 原則 | 2つの2Dセンサーからのステレオ画像の視差を比較 | 立体面による照明パターンの歪みを検出 | 対象物からの反射光の通過時間を測定 |

| ソフトウェアの複雑性 | 高 | 中 | 低 |

| 部材費 | 低 | 高 | 中 |

| 深度(「z」)の精度 | cm | um~cm | mm~cm |

| 深度範囲 | 限定 | 調整可 | 調整可 |

| 低照度 | 弱 | 良 | 良 |

| 室外 | 良 | 弱 | 平 |

| 反応時間 | 中 | 遅 | 速 |

| コンパクト性 | 低 | 高 | 低 |

| 消費電力 | 低 | 中 | 調整可 |

深度センシングカメラを使用する一般的な組み込みビジョンアプリケーション

前述のように、自律的にナビゲートする必要があるデバイスには深度センシングが必要です。ただし、以下に示すのは、シームレスな機能を実現するために3D深度カメラを必要とする最も一般的な組み込みビジョンアプリケーションの一部です。

- 自律移動ロボット (AMR)

- 自律トラクター

- 人数カウントおよび顔のなりすまし防止システム

- 遠隔患者モニタリング

自律移動ロボット

自律型移動ロボット (AMR) は、産業、小売、農業、および医療アプリケーション全体で様々なタスクを自動化するのに役立っています。以下は、倉庫、小売店、病院、オフィスビル、農業分野などで使用されるAMRの例です。

- 物品対人ロボット

- ピックアンドプレースロボット

- テレプレゼンスロボット

- 収穫ロボット

- 自動除草機

- パトロールロボット

- 掃除ロボット

どのようなタイプであっても、人間の監視なしで自律的に移動する必要があるロボットには、3D深度カメラが必要です。深度センシングカメラを使用する一部のロボットの中には、自動ナビゲーションと人間によるナビゲーションを組み合わせて使用する場合があります。 そのような場合でも、デプスカメラは障害物を検出して事故を回避するのに役立ちます。このタイプのロボットの一例が配送ロボットです。

AMRで深度カメラがどのように機能するかをよりよく理解するには、「自律移動ロボットはTime of Flight技術をどのように使用しますか?」をご参照ください。

当社が、カメラを統合して正確な物体検出とエラーのないバーコード読み取りを可能にすることで、大手自律移動ロボットメーカーが倉庫の自動化を強化するのをどのように支援したかをご覧ください。

自律トラクター

自律型トラクターは、耕作、雑草と虫の検出、作物の監視などの主要な農業プロセスを自動化するために使用されます。深度センシングに関しては、AMRと同様に機能します。 深度カメラは、ある地点から別の地点に移動するために、障害物や近くの物体までの距離を測定するのに役立ちます。この自律的に動く能力は、農業産業における労働力不足を考えると、画期的なものです。

人数カウントおよび顔のなりすまし防止システム

人数カウントと顔のなりすまし防止システムは、人数をカウントし、人物管理とアクセス制御における不正を検出するために使用されます。ここでは、カウントや顔認識の際に人物の正確な位置や位置を特定するために、ステレオカメラやTime of Flightカメラのような3D深度カメラが必要です。

遠隔患者モニタリング

最新の遠隔患者監視システムは、人工知能とカメラ技術を活用して患者の転倒などの重要な状態を検出することで、24時間365日、完全に無人で患者を監視できるようにします。しかし、転倒を検出するには、患者の映像を撮影し、分析のために共有および保存する必要があります。 これにより、プライバシーに関わる問題が発生します。 ここで、3D深度カメラが役に立ちます。

これらの最先端のカメラシステムの助けを借りて、深度データのみを使用して転倒患者の動きを追跡できます。これにより、プライバシーが確保され、視覚的に識別可能な画像やビデオがリモート患者監視カメラによって処理されないため、患者に安心感が与えられます。

3Dデプスカメラ (特にTime of Flightカメラ)が患者監視システムのプライバシー向上にどのように役立つかについてさらに詳しく知りたい場合は、Time of Flightカメラが遠隔患者監視をより安全かつプライベートにする方法をお読みください。

これが深度センサーカメラの特徴です。このトピックについてさらにご質問がある場合は、お気軽にお問い合わせください。

3D デプスカメラを自動運転車に組み込む方法についてのご質問は、camerasolutions@e-consystems.com までお問い合わせください。また、カメラセレクターにアクセスして、カメラの完全なラインナップを確認することもできます。

Prabu Kumarは、e-con Systemsの最高技術責任者兼カメラ製品責任者であり、組み込みビジョン分野で15年以上の豊富な経験があります。彼は、USBカメラ、組み込みビジョンカメラ、ビジョンアルゴリズム、FPGAに関する深い知識をも有しています。医療、工業、農業、小売、生体認証などのさまざまなドメインにまたがる50以上のカメラソリューションを構築してきました。また、デバイスドライバー開発とBSP開発の専門家でもあります。現在は、新時代のAIベースのアプリケーションを強化するスマートカメラソリューションの構築に全力を注いでいます。